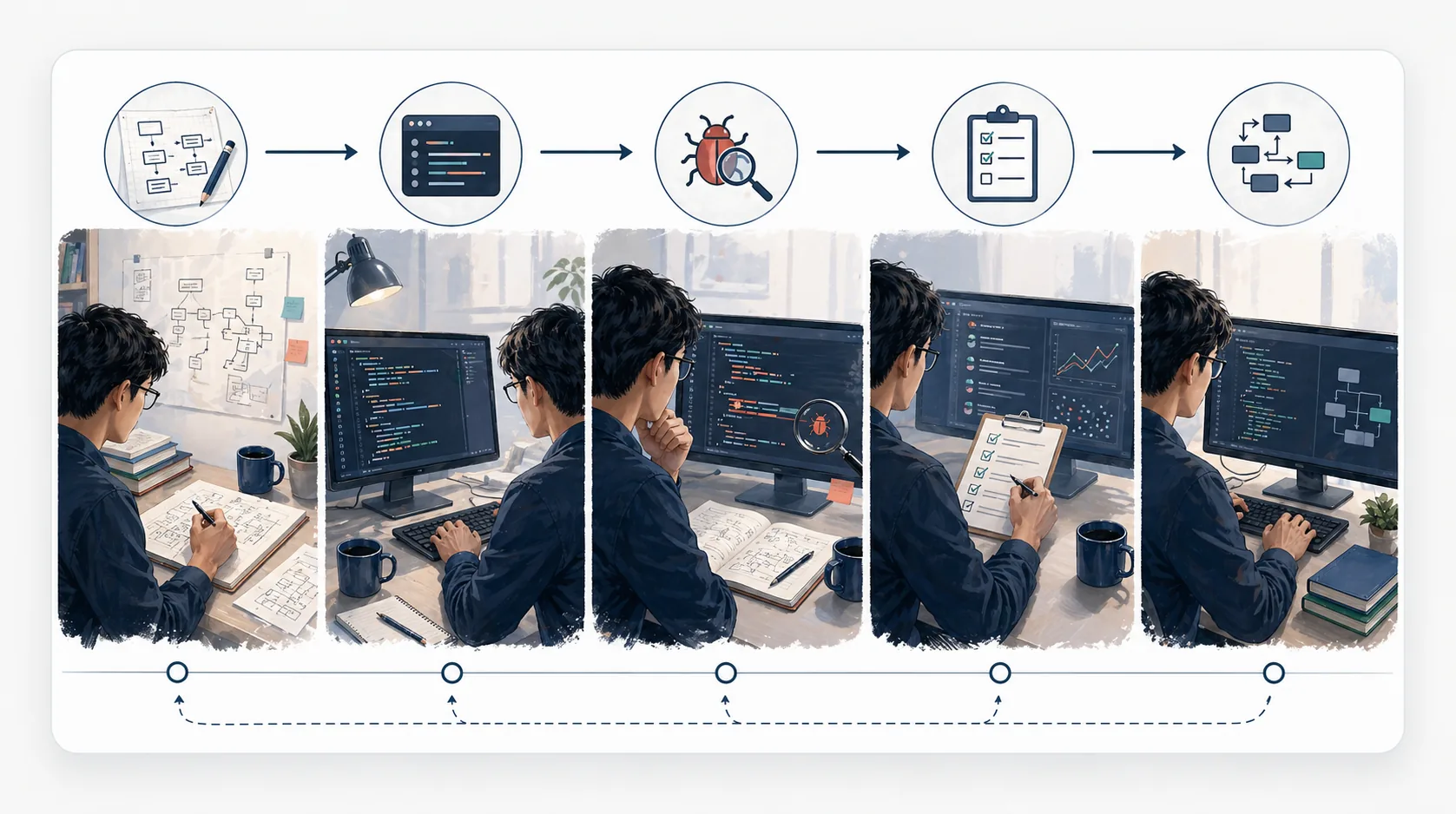

传统编程

人先把问题拆成架构、接口、算法和边界条件,然后手写实现、手动 debug、手动补测试。速度主要受“打字 + 查 API + 重构 + 细节记忆”限制。

- 优势:控制精确、路径透明、可预测。

- 瓶颈:大量时间花在重复实现和样板细节上。

- 适合:高风险底层系统、需要完全可控的核心模块。

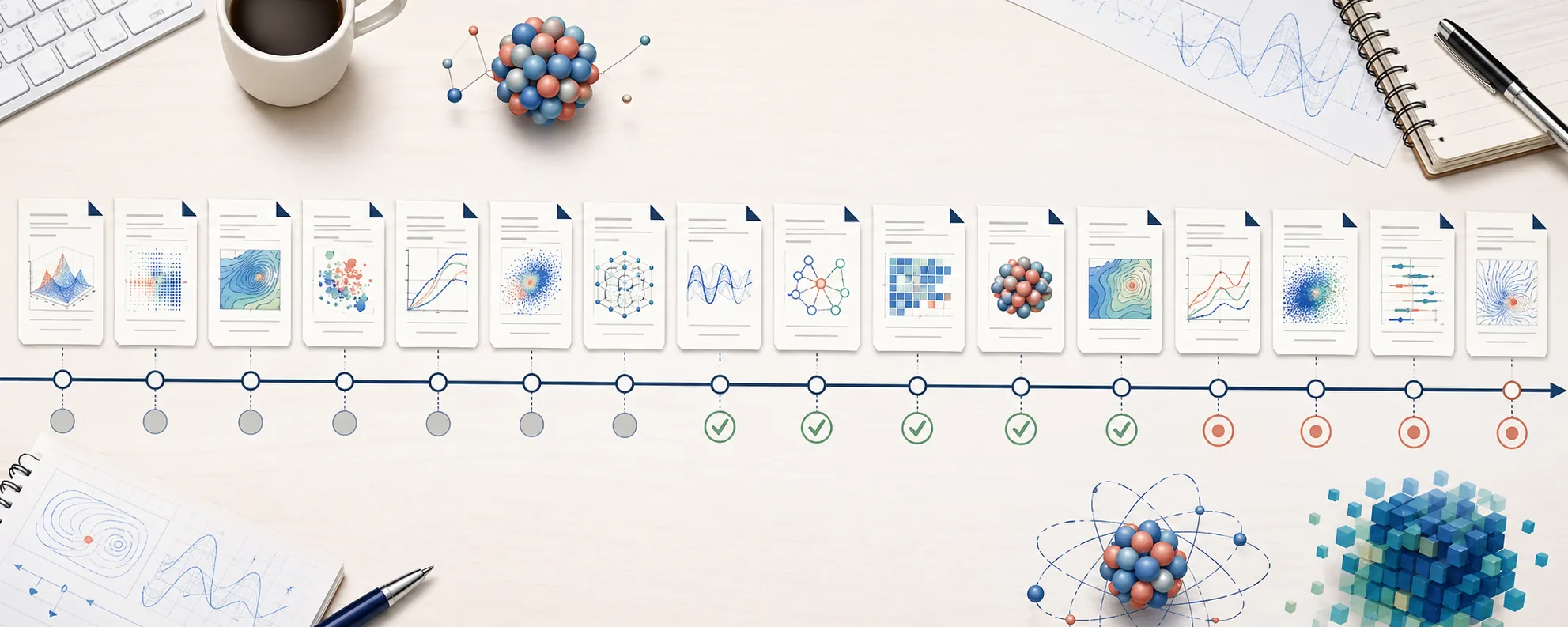

下面这两个数字来自同一个导师、同一套物理、同一类问题。变量只有一个:谁在写代码。

一个项目的智力内核(一个想法、一个算法、一个数值不稳定的来源)通常在几天到几周内结晶。 把它变成一篇发表论文,要花几个月到几年。 传统流程里,implementation overhead 占据绝大部分时间。

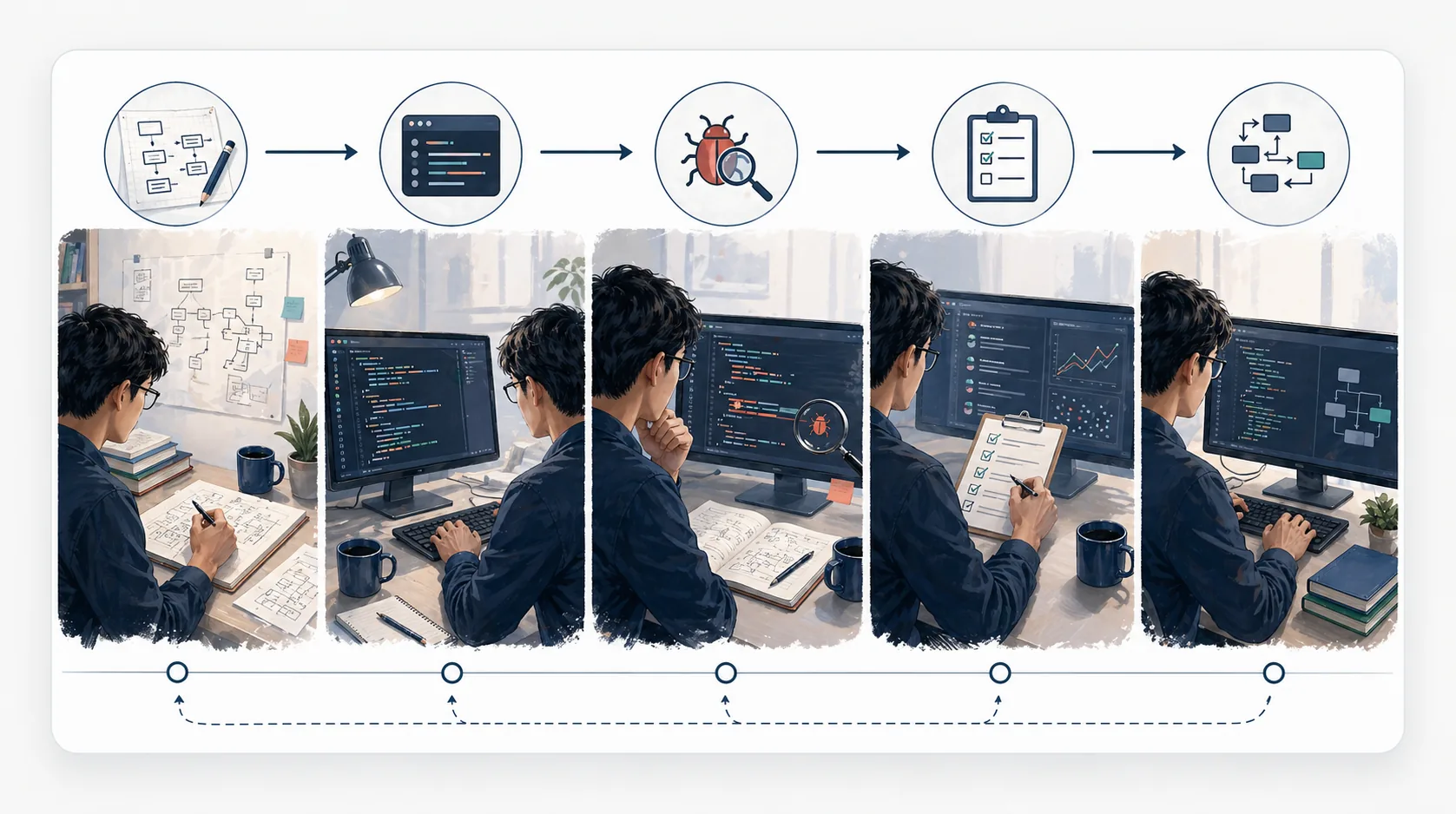

传统编程的核心动作是“人把意图翻译成代码”。Vibe Coding 的核心动作变成: 人用自然语言、运行结果和反馈来驱动 AI 生成代码,再用测试和判断筛选结果。 也就是说,人从逐行施工者,变成了目标设定者、审稿人和系统导演。

人先把问题拆成架构、接口、算法和边界条件,然后手写实现、手动 debug、手动补测试。速度主要受“打字 + 查 API + 重构 + 细节记忆”限制。

人描述目标、约束和反馈,AI 快速生成实现。人的主要工作不是替 AI 写每一行,而是不断判断输出是否满足真实目标,并把系统拉回正确方向。

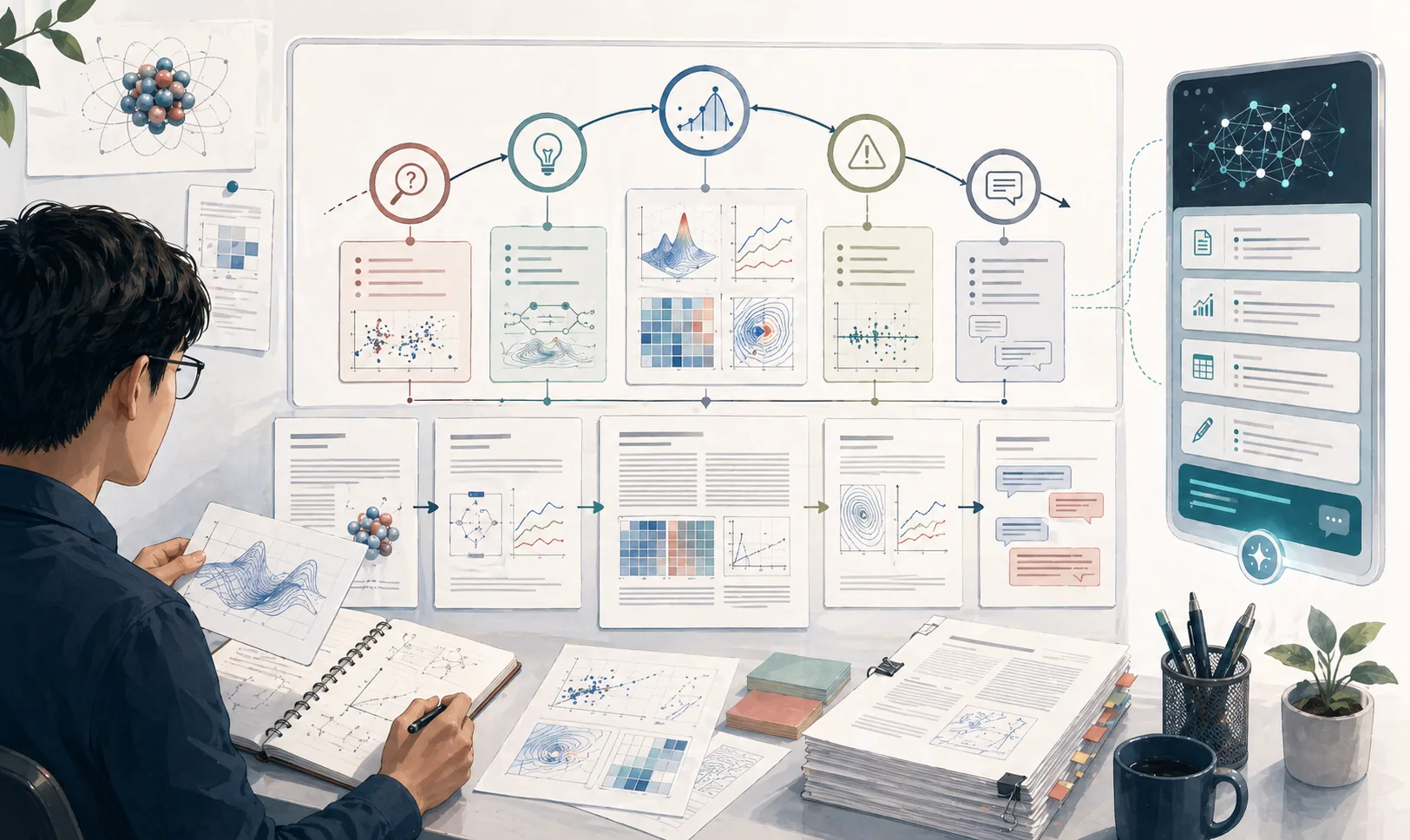

Vibe Research 不是“让 AI 做科研”。它是把 Vibe Coding 的速度引入科研流程, 但把问题选择、物理判断、验证标准、claim 边界和最终责任牢牢留在人这里。 AI 负责把人的判断快速变成代码、图、诊断、文献表和论文草稿;人负责判断这些东西是否真的构成物理。

什么问题值得做、哪个近似可接受、哪个 observable 能证明观点,这些不能外包。

代码实现、脚本、图表、文献整理、初稿和审稿回复,是 AI 最适合加速的摩擦层。

速度越快,越要把 benchmark、守恒律、单位、边界条件和 worst case 放在主流程里。

AI 可以写得漂亮,但 claim 的强度必须由证据决定。过度外推会毁掉可信度。

这两个工具不是谁替代谁,而是适合不同形态的工作。Claude Code 更像一个贴着 Claude 生态的终端研究助手; Codex 更像 OpenAI 生态里的工程 agent 平台,尤其适合并行 coding、页面构建和需要图像生成的工作流。

适合把长文档、PDF、代码库和科研上下文放在同一个会话里推进。对研究者来说,它的强项是读材料、 追上下文、按你的物理判断写代码和改论文相关文件。

适合构建页面、改代码、跑测试、并行拆任务,以及把 OpenAI 的工具能力接入工程流程。这个页面里的大量插图, 就是通过 Codex 环境调用 T2I 生成后落到项目资产里的。

Vibe Research 不是把问题扔给 AI,然后等论文掉出来。它更像一个研究操作系统: 每一步都明确谁负责、停在哪个 checkpoint、什么结果必须由人来判定。

AI 写出来的代码越快,验证链越要硬。每个研究项目都应该有一张小的 validation matrix: 它不追求覆盖所有情况,而是覆盖最容易让物理出错的地方。

下面是三段从 ahu-talk 的两个 PRC 项目里抽出来的会话脚本,我把它做成可逐步播放的伪终端。 关键节点会跳出 Expert Filter 提醒,需要你点确认才继续 — 这正是真实研究中你应该做的。

真正省时间的地方不只是写代码,而是把本地验证、HPC 调度、诊断图、误差预算和论文图表变成连续管线。 这部分适合让 Claude 做大量机械工作,但每个阶段都要留下可复现证据。

LLM 最危险的地方不是报错,而是把错误写得很顺。下面这些模式都适合做成项目里的 regression test 或 review checklist。

Skill 是带触发词的"封装好的工作流"。在 Claude Code 里输入 /skill-name 或者命中触发词时自动加载。

点击卡片复制调用样例。

写作阶段最该让 AI 加速的是结构化整理:文献证据、图表叙事、审稿意见回应。最不该交给它的是 claim 的边界。

好的会话不是从“帮我看看”开始,而是从边界条件开始:今天的目标、允许它改什么、 禁止它自作主张什么、什么时候必须停下来等你审。

这些是我常用的 prompt 骨架。复制下来,把尖括号里的占位符换成你的内容,再粘到 Claude Code 里。

Vibe Research 的反直觉推论:LLM 不是民主化研究,是放大专家优势。 没有 Expert Filter 的人照搬这套流程,会高速产出错的物理。 下面 8 条你都能诚实勾选时,再开始。